Kompakt AI'nın akıl yürütme gücü: Zorlu GPT?

Son yıllarda, AI topluluğu büyük dil modellerinin (LLMS) dikkate değer başarılarından etkilenmiştir. Başlangıçta doğal dil işleme için hazırlanmış olan bu modeller, insan akıl yürütmesine benzer adım adım bir düşünce süreciyle karmaşık problemleri çözebilen sofistike akıl yürütme araçlarına dönüştü. Bununla birlikte, gelişmiş yeteneklerine rağmen, LLM'ler, yüksek hesaplama maliyetleri ve yavaş dağıtım hızları da dahil olmak üzere önemli dezavantajlara sahiptir, bu da onları mobil cihazlar veya kenar hesaplama gibi kaynak sınırlı ayarlarda gerçek dünya uygulamaları için daha az uygulanabilir hale getirir. Bu, maliyetleri ve kaynak taleplerini en aza indirirken karşılaştırılabilir akıl yürütme yetenekleri sağlayabilen daha küçük, daha verimli modellerin geliştirilmesine büyük ilgi göstermiştir. Bu makale, bu küçük akıl yürütme modellerinin ortaya çıkmasını, potansiyellerini, zorluklarını ve AI manzarasının gelecekteki sonuçlarını araştırmayı araştırıyor.

Perspektifte bir değişim

Yapay zekanın yakın tarihinde önemli bir dönem için, alan, model performansının veri, hesaplama gücü ve model boyutu artışı olarak tahmin edilebilir bir şekilde iyileştirdiğini öne süren “ölçeklendirme yasaları” ilkesine bağlı kalmıştır. Bu yaklaşım gerçekten de güçlü modeller üretmiş olsa da, yüksek altyapı maliyetleri, çevresel etki ve gecikme sorunları gibi önemli değişimlere de yol açmıştır. Tüm uygulamalar, yüz milyarlarca parametreye sahip büyük modellerin tüm yeteneklerini gerektirmez. Avantajlı asistanlar, sağlık ve eğitim gibi birçok pratik senaryoda, küçük modeller etkili bir şekilde akıl yürütebilecekleri şartıyla karşılaştırılabilir sonuçlar elde edebilir.

AI'da Akıl Yuvasını Anlamak

Yapay zekada akıl yürütme, bir modelin mantıksal dizileri takip etme, nedeni ve etkiyi anlama, sonuçları çıkarma, prosedür adımları planlama ve çelişkileri tanımlama yeteneğini kapsar. Dil modelleri için bu sadece bilgileri almakla kalmayıp aynı zamanda yapılandırılmış, adım adım bir yaklaşımla verileri manipüle etmeyi ve çıkarmayı da içerir. Bu akıl yürütme seviyesine ulaşmak tipik olarak bir sonuca varmadan önce çok aşamalı akıl yürütme yapmak için ince ayar llms gerektirir. Etkili olsa da, bu yöntemler kaynak yoğundur ve konuşlandırılması yavaş ve maliyetli olabilir, bu da erişilebilirlikleri ve çevresel etkileri konusunda endişeleri artırır.

Küçük akıl yürütme modellerini anlamak

Küçük akıl yürütme modelleri, büyük modellerin akıl yürütme yeteneklerini çoğaltmayı amaçlamaktadır, ancak hesaplama gücü, bellek kullanımı ve gecikme açısından daha fazla verimlilikle. Bu modeller genellikle daha küçük bir modelin (“öğrenci”) daha büyük, önceden eğitilmiş bir modelden (“öğretmen”) öğrendiği bilgi damıtma olarak bilinen bir tekniği kullanır. Damıtma işlemi, akıl yürütme yeteneğini aktarmayı amaçlayan, daha büyük olanın ürettiği veriler üzerinde daha küçük modelin eğitilmesini içerir. Daha sonra öğrenci modeli performansını artırmak için ince ayar yapılır. Bazı durumlarda, modelin göreve özgü akıl yürütme yeteneğini daha da geliştirmek için özel alana özgü ödül fonksiyonları ile takviye öğrenimi kullanılmaktadır.

Küçük akıl yürütme modellerinin yükselişi ve gelişmeleri

Küçük akıl yürütme modellerinin geliştirilmesinde önemli bir an, Deepseek-R1'in serbest bırakılmasıyla işaretlendi. Nispeten mütevazı bir eski GPU kümesi üzerinde eğitilen Deepseek-R1, MMLU ve GSM-8K gibi kriterlerde Openai'nin O1 gibi daha büyük modelleriyle karşılaştırılabilir performans seviyelerine ulaştı. Bu başarı, daha büyük modellerin doğal olarak üstün olduğunu varsayan geleneksel ölçeklendirme yaklaşımının yeniden değerlendirilmesine neden oldu.

Deepseek-R1'in başarısı, ilk aşamalarda denetimli ince ayarlamaya güvenmeden büyük ölçekli takviye öğrenimini birleştiren yenilikçi eğitim sürecine atfedilebilir. Bu yenilik, büyük akıl yürütme modellerine kıyasla etkileyici akıl yürütme yetenekleri sergileyen bir model olan Deepseek-R1-Zero'nun yaratılmasına yol açtı. Soğuk başlangıç verilerinin kullanımı gibi daha fazla geliştirmeler, özellikle matematik ve kodlama gibi alanlarda modelin tutarlılığını ve görev yürütmesini geliştirdi.

Ek olarak, damıtma tekniklerinin daha büyük olanlardan daha küçük, daha verimli modeller geliştirmede enstrümantal olduğu kanıtlanmıştır. Örneğin, Deepseek, modellerinin 1.5 milyar ila 70 milyar parametre boyutunda damıtılmış versiyonları yayınladı. Bu modelleri kullanarak, araştırmacılar, Openai'nin O1-mini'den çeşitli ölçütlerde daha iyi performans gösteren önemli ölçüde daha küçük bir model olan Deepseek-R1-Distill-Qwen-32B eğittiler. Bu modeller artık standart donanıma dağıtılabilmiştir, bu da onları çok çeşitli uygulamalar için daha uygun bir seçenek haline getirir.

Küçük modeller GPT düzeyinde akıl yürütme ile eşleşebilir mi?

Küçük akıl yürütme modellerinin (SRMS) GPT gibi büyük modellerin (LRMS) muhakeme gücüyle eşleşip eşleşemeyeceğini belirlemek için standart kriterlerdeki performanslarını değerlendirmek çok önemlidir. Örneğin, Deepseek-R1 modeli, MMLU testinde O1 gibi daha büyük modellerle karşılaştırılabilen 0.844 civarında puan aldı. Sınıf okulu matematiğine odaklanan GSM-8K veri kümesinde, Deepseek-R1'in damıtılmış modeli hem O1 hem de O1-mini'yi aşarak üst düzey performans elde etti.

LiveCodebench ve CodeForces'dakiler gibi kodlama görevlerinde, Deepseek-R1'in damıtılmış modelleri O1-Mini ve GPT-4O'ya benzer şekilde performans göstererek programlamada güçlü akıl yürütme yetenekleri gösterdi. Bununla birlikte, daha büyük modeller, daha küçük modeller daha göreve özgü olma eğiliminde olduğundan, daha geniş dil anlayışı veya uzun bağlam pencerelerini işleyen görevlerde hala bir avantaja sahiptir.

Güçlü yönlerine rağmen, küçük modeller genişletilmiş akıl yürütme görevleriyle veya dağılım dışı verilerle karşılaştığında mücadele edebilir. Örneğin, LLM satranç simülasyonlarında, Deepseek-R1 daha büyük modellerden daha fazla hata yaptı, bu da uzun süreler boyunca odak ve doğruluğu koruma yeteneğinde sınırlamaları gösterdi.

Ödünleşmeler ve pratik sonuçlar

SRM'leri GPT düzeyinde LRM'lerle karşılaştırırken model boyutu ve performans arasındaki değişimler kritiktir. Daha küçük modeller, daha az bellek ve hesaplama gücü gerektirir, bu da onları kenar cihazları, mobil uygulamalar veya çevrimdışı çıkarımın gerekli olduğu durumlar için ideal hale getirir. Bu verimlilik, daha düşük operasyonel maliyetlerle sonuçlanır, Deepseek-R1 gibi modeller O1 gibi daha büyük modellerden daha ucuza% 96'ya kadar daha ucuzdur.

Ancak, bu verimlilik kazanımları bazı uzlaşmalarla birlikte gelir. Daha küçük modeller tipik olarak, daha büyük modellere kıyasla çok yönlülüklerini sınırlayabilen belirli görevler için ince ayardır. Örneğin, Deepseek-R1 matematik ve kodlamada mükemmel olsa da, GPT-4O gibi daha büyük modellerin işleyebileceği görüntüleri yorumlama yeteneği gibi multimodal yeteneklerden yoksundur.

Bu sınırlamalara rağmen, küçük akıl yürütme modellerinin pratik uygulamaları kapsamlıdır. Sağlık hizmetlerinde, standart hastane sunucularındaki tıbbi verileri analiz eden teşhis araçlarını güçlendirebilirler. Eğitimde, öğrencilere adım adım geri bildirim sağlayarak kişiselleştirilmiş ders sistemleri geliştirmek için kullanılabilirler. Bilimsel araştırmalarda, matematik ve fizik gibi alanlarda veri analizi ve hipotez testlerine yardımcı olabilirler. Deepseek-R1 gibi modellerin açık kaynaklı doğası da işbirliğini teşvik eder ve AI'ya erişimi demokratikleştirir ve daha küçük kuruluşların ileri teknolojilerden yararlanmasını sağlar.

Sonuçta

Dil modellerinin daha küçük akıl yürütme modellerine evrimi, yapay zekada önemli bir ilerlemeyi temsil etmektedir. Bu modeller henüz büyük dil modellerinin geniş yetenekleriyle tam olarak eşleşmese de, verimlilik, maliyet etkinliği ve erişilebilirlikte temel avantajlar sunarlar. Akıl yürütme gücü ve kaynak verimliliği arasında bir denge kurarak, daha küçük modeller, çeşitli uygulamalarda önemli bir rol oynamaya hazırdır ve AI'yı gerçek dünya kullanım için daha pratik ve sürdürülebilir hale getirir.

-

1

Stardew Valley: Büyüler ve Silah Dövmesi İçin Tam Bir Kılavuz

Jan 07,2025

-

2

Roblox UGC Sınırlı Kodları Ocak 2025'te Açıklandı

Jan 06,2025

-

3

Pokémon TCG Pocket: Sorun Giderme Hatası 102 Çözüldü

Jan 08,2025

-

4

Blue Archive Siber Yeni Yıl Mart Etkinliğini Açıkladı

Dec 19,2024

-

5

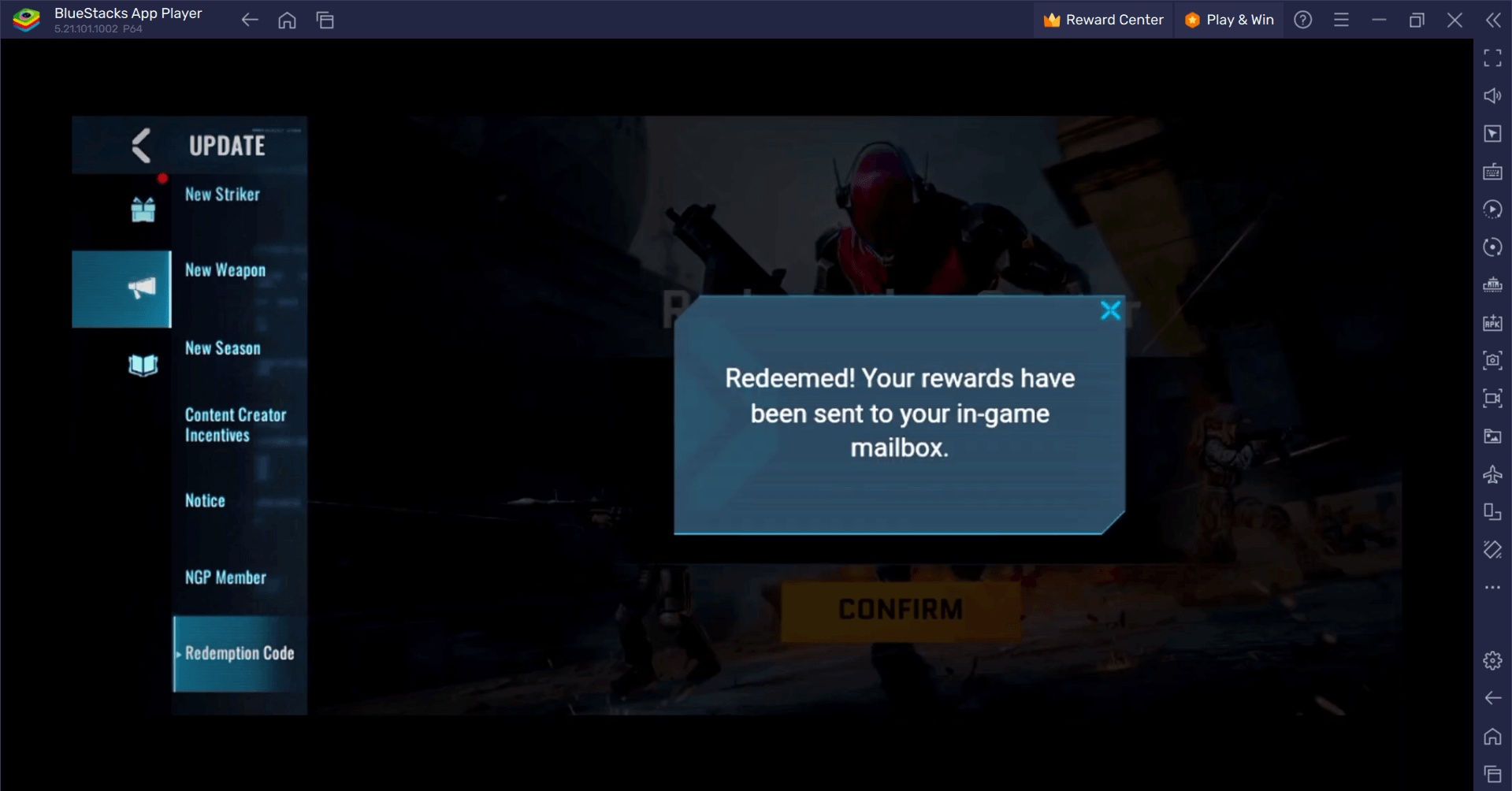

Blood Strike - Tüm Çalışma Kodlarını Kullanma Ocak 2025

Jan 08,2025

-

6

Siber Görev: Android'de Büyüleyici Kart Savaşlarına Katılın

Dec 19,2024

-

7

![ROBLOX FORSENEN KARAKTER LİSTESİ [Güncellenmiş] (2025)](https://imgs.ksjha.com/uploads/18/17380116246797f3e8a8a39.jpg)

ROBLOX FORSENEN KARAKTER LİSTESİ [Güncellenmiş] (2025)

Mar 17,2025

-

8

Bart Bonte, Oynadığınız Yerde Yeni Bir Bulmaca Sunuyor Mister Antonio Bir Kedi 'İçin' Getirin!

Dec 18,2024

-

9

Sony Yeni Midnight Siyah PS5 Aksesuarlarını Ortaya Çıkarıyor

Jan 08,2025

-

10

Roblox: RIVALS Kodları (Ocak 2025)

Jan 07,2025

-

İndirmek

Random fap scene

Gündelik / 20.10M

Güncelleme: Dec 26,2024

-

İndirmek

![Corrupting the Universe [v3.0]](https://imgs.ksjha.com/uploads/66/1719514653667db61d741e9.jpg)

Corrupting the Universe [v3.0]

Gündelik / 486.00M

Güncelleme: Dec 17,2024

-

İndirmek

Arceus X script

Kişiselleştirme / 127.00M

Güncelleme: Oct 21,2021

-

4

A Simple Life with My Unobtrusive Sister

-

5

Ben 10 A day with Gwen

-

6

A Wife And Mother

-

7

Permit Deny

-

8

Oniga Town of the Dead

-

9

Cute Reapers in my Room Android

-

10

Piano White Go! - Piano Games Tiles