Compact AI ၏ကျိုးကြောင်းဆင်ခြင်မှုပါဝါ - Horthing GPT?

မကြာသေးမီနှစ်များအတွင်း AI အသိုင်းအဝိုင်းသည်ကြီးမားသောဘာသာစကားမော်ဒယ်များ (LLMS) ၏ထူးခြားသောအောင်မြင်မှုများကိုစိတ်ဝင်စားဖွယ်ကောင်းသည်။ မူလကသဘာဝဘာသာစကားဖြင့်ထုတ်လုပ်ရန်အတွက်ဤမော်ဒယ်များသည်ရှုပ်ထွေးသောပြ problems နာများကိုဖြေရှင်းနိုင်သည့်ရှုပ်ထွေးသောပြ problems နာများကိုဖြေရှင်းနိုင်သည့်ရှုပ်ထွေးသောကျိုးကြောင်းဆင်ခြင်မှုကိရိယာများအဖြစ်သို့ပြောင်းလဲသွားခဲ့သည်။ သို့သော်၎င်းတို့၏အဆင့်မြင့်စွမ်းရည်များရှိသော်လည်း LLMS သည်အထွေထွေအသုံးစရိတ်များနှင့်ဖြန့်ကျက်မှုမြန်နှုန်းမြင့်မားခြင်းများအပါအ 0 င်ထင်ရှားသောအားနည်းချက်များရှိနေသည်။ ၎င်းသည်သေးငယ်သော, ပိုမိုထိရောက်သောစွမ်းဆောင်ရည်မြင့်မားသောအရည်အချင်းများကိုပိုမိုဖွံ့ဖြိုးတိုးတက်စေရန်အတွက်ကုန်ကျစရိတ်နှင့်အရင်းအမြစ်တောင်းဆိုမှုများကိုလျှော့ချစဉ်နှိုင်းယှဉ်နိုင်သောကျိုးကြောင်းဆင်ခြင်မှုစွမ်းရည်များကိုဖြည့်ဆည်းပေးနိုင်သည်။ ဤဆောင်းပါးသည်၎င်းတို့၏အလားအလာ, စိန်ခေါ်မှုများနှင့် AI ရှုခင်းအတွက်အနာဂတ်သက်ရောက်မှုများကိုစူးစမ်းလေ့လာခြင်း,

ရှုထောင့်အတွက်အပြောင်းအလဲ

မကြာသေးမီက AI ၏သမိုင်းကြောင်းတွင်သိသာထင်ရှားသည့်ကာလအတွက်လယ်ကွင်းသည် "ချုံ့ခြင်းဥပဒေများ" ၏နိယာမကိုလိုက်နာပြီးမော်ဒယ်စွမ်းဆောင်ရည်သည်အချက်အလက်များ, တွက်ချက်မှုနှင့်မော်ဒယ်အရွယ်အစားတိုးလာသည်။ ဤချဉ်းကပ်မှုသည်အစွမ်းထက်သောမော်ဒယ်များကိုအမှန်တကယ်ထုတ်လုပ်ခဲ့သော်လည်းအခြေခံအဆောက်အအုံကုန်ကျစရိတ်များ, ပတ် 0 န်းကျင်ဆိုင်ရာသက်ရောက်မှုများ, applications အားလုံးသည်ရာနှင့်ချီသောသတ်မှတ်ချက်များနှင့်ချီသော parameters များနှင့်အတူကြီးမားသောမော်ဒယ်များ၏အပြည့်အဝစွမ်းရည်ကိုမလိုအပ်ပါ။ လက်တွေ့ကျကျလက်ထောက်များ, ကျန်းမာရေးစောင့်ရှောက်မှုနှင့်ပညာရေးငယ်များနှင့်ပညာရေးငယ်များသည်နှိုင်းယှဉ်နိုင်သောရလဒ်များကဲ့သို့သောလက်တွေ့ကျသောအခြေအနေများစွာတွင်နှိုင်းယှဉ်နိုင်သောရလဒ်များရရှိနိုင်ပါသည်။

AI အတွက်ကျိုးကြောင်းဆင်ခြင်နားလည်ခြင်း

AI တွင်ကျိုးကြောင်းဆင်ခြင်ခြင်းသည်စံနမူနာရှင်များကိုလိုက်နာရန်, အကြောင်းရင်းများနှင့်အကျိုးသက်ရောက်မှုများကိုနားလည်ရန်, ဘာသာစကားမော်ဒယ်များအတွက်သတင်းအချက်အလက်များကိုပြန်လည်ရယူခြင်းသာမကအချက်အလက်များကိုစနစ်တကျချဉ်းကပ်နည်းဖြင့်တာ 0 န်ယူမှုနှင့်ကူးစက်ခြင်းကိုပြုလုပ်သည်။ ဤဆင်ခြင်တုံတရား၏ဤကျိုးကြောင်းဆင်ခြင်မှုအဆင့်ကိုရရှိခြင်းသည်ပုံမှန်အားဖြင့်နိဂုံးချုပ်မရောက်ရှိမီ Multi-step furting လုပ်ရန်အဆင်ပြေသည့် llls လိုအပ်သည်။ ထိရောက်သောအခါဤနည်းလမ်းများသည်သယံဇာတအရင်းအမြစ်များကိုအထူးကြပ်မတ်များဖြစ်ပြီးနှေးကွေးပြီးအကုန်အကျများပြီး၎င်းတို့၏လက်လှမ်းမီမှုနှင့်ပတ် 0 န်းကျင်ဆိုင်ရာသက်ရောက်မှုများနှင့် ပတ်သက်. စိုးရိမ်မှုများကိုမြှင့်တင်ရန်နှေးကွေး။ အကုန်အကျများနိုင်သည်။

အသေးစားအကြောင်းပြချက်မော်ဒယ်များကိုနားလည်ခြင်း

အသေးစားအကြောင်းပြချက်မော်ဒယ်များသည်ကြီးမားသောမော်ဒယ်များ၏ကျိုးကြောင်းဆင်ခြင်မှုစွမ်းရည်များကိုပုံတူပွားရန်ရည်ရွယ်သည်။ သို့သော်တွက်ချက်မှုအာဏာ, ဤရွေ့ကားမော်ဒယ်များသည်သေးငယ်သည့်မော်ဒယ် ("ကျောင်းသား") သည်ပိုမိုကြီးမားသော, ပေါင်းခံရပ်နားလုပ်ငန်းစဉ်တွင်ကျိုးကြောင်းဆင်ခြင်မှုစွမ်းရည်ကိုလွှဲပြောင်းရန်ရည်ရွယ်သည့်ပိုကြီးသည့်အချက်အလက်များမှရရှိသောအချက်အလက်များကိုလေ့ကျင့်ခြင်းပါဝင်သည်။ ကျောင်းသားမော်ဒယ်သည်၎င်း၏စွမ်းဆောင်ရည်ကိုမြှင့်တင်ရန်ညှိနှိုင်းသည်။ အချို့သောဖြစ်ရပ်များတွင်အထူးဒိုမိန်း - တိကျသောဆုလာဘ်လုပ်ဆောင်ချက်များကိုအားဖြည့်ခြင်း,

သေးငယ်တဲ့ကျိုးကြောင်းဆင်ခြင်မော်ဒယ်များ၏မြင့်တက်ခြင်းနှင့်တိုးတက်မှု

သေးငယ်တဲ့ကျိုးကြောင်းဆင်ခြင်မှုမော်ဒယ်များ၏ဖွံ့ဖြိုးတိုးတက်မှုအတွက်အဓိကအကြောင်းရင်းကို deepseek-r1 လွှတ်ပေးရေးကမှတ်သားခဲ့သည်။ MMLU နှင့် GSM-8K ကဲ့သို့သောစံနှုန်းများနှင့်နှိုင်းယှဉ်လျှင်ပိုမိုကြီးမားသောမော်ဒယ်များနှင့်နှိုင်းယှဉ်နိုင်သောစွမ်းဆောင်ရည်အဆင့်များနှင့်နှိုင်းယှဉ်နိုင်သောစွမ်းဆောင်ရည်အဆင့်ကိုလေ့ကျင့်သင်ကြားပေးခဲ့သည်။ ဤအောင်မြင်မှုသည်ရိုးရာစကေးချဉ်းကပ်မှုကိုပြန်လည်ထူထောင်ရန်သတိပေးခံရသည်။

DeepSeek-R1 ၏အောင်မြင်မှုကို၎င်း၏ဆန်းသစ်သောလေ့ကျင့်မှုလုပ်ငန်းစဉ်နှင့်စပ်လျဉ်း။ ဆန်းသစ်သောလေ့ကျင့်မှုလုပ်ငန်းစဉ်နှင့် ပတ်သက်. အကြီးအကျယ်အားဖြည့်ခြင်းသင်တန်းကိုအစောပိုင်းအဆင့်ဆင့်တက်ခြင်းကိုမကိုးစားဘဲမှီခိုအားထားခြင်းမရှိဘဲဆွဲဆောင်နိုင်ခဲ့သည်။ ဒီဆန်းသစ်တီထွင်မှုက DeepSeek-R1-Zero ကိုဖန်တီးဖို့ ဦး ဆောင်ခဲ့တယ်။ အအေးမိသည့်အချက်အလက်များကိုအသုံးပြုခြင်းကဲ့သို့သောနောက်ထပ်တိုးတက်မှုများ, အထူးသဖြင့်သင်္ချာနှင့် coding ကဲ့သို့သောဒေသများတွင်မော်ဒယ်၏သဟဇာတနှင့်လုပ်ငန်းတာဝန်ကိုကွပ်မျက်ခြင်းများကိုတိုးတက်စေသည်။

ထို့အပြင်အိပ်စက်ခြင်းဆိုင်ရာနည်းစနစ်များသည်ပိုမိုကြီးမားသောထိရောက်သောမော်ဒယ်များကိုပိုမိုကျယ်ပြန့်သောပိုမိုထိရောက်သောမော်ဒယ်များကိုဖော်ထုတ်နိုင်ရန်အထောက်အထားများပြသခဲ့သည်။ ဥပမာအားဖြင့် BLELSEEK သည် 1.5 ဘီလီယံမှ 70 ဘီလီယံမှ 70 ဘီလီယံအထိအရွယ်အစားအထိအရွယ်အစားမြင့်မားသောပုံစံများကိုဖြန့်ချိခဲ့သည်။ ဤမော်ဒယ်များကို အသုံးပြု. သုတေသီများသည်သိသိသာသာသေးငယ်သည့်ပုံစံဖြစ်သော DeepSeek-R1-Distill-Qwen-32B ကိုအခြေခံစံချိန်အမျိုးမျိုးကိုဖြတ်ကျော်ပြီး OpenChmarks မှ oparchmarks opena ကို ကျော်လွန်. OpenChark-R1-32b တို့အားသိသိသာသာသေးငယ်သည့်ပုံစံကိုလေ့ကျင့်သင်ကြားပေးခဲ့သည်။ ယခုမော်ဒယ်များကို Standard Hardware တွင်နေရာချထားသိမ်းထားပြီးကျယ်ပြန့်သော application များအတွက်ပိုမိုကောင်းမွန်သော option ကိုပြုလုပ်နိုင်သည်။

အသေးစားမော်ဒယ်များသည် GPT-Level ဆင်ခြင်ခြင်းနှင့်ကိုက်ညီနိုင်ပါသလား။

Models (SRMs) သည်ကြီးမားသောမော်ဒယ်များ (LRMs) ၏ကျိုးကြောင်းဆင်ခြင်မှု (LRMS) ၏ကျိုးကြောင်းဆင်ခြင်မှုနှင့်ကိုက်ညီမှုရှိမရှိဆုံးဖြတ်ရန်မှာစံစံသတ်မှတ်ချက်များအပေါ်သူတို့၏စွမ်းဆောင်ရည်ကိုအကဲဖြတ်ရန်အရေးကြီးသည်။ ဥပမာအားဖြင့်, Dayseek-R1 မော်ဒယ်သည် MMLU စစ်ဆေးမှုတွင် 0.844 0 န်းကျင်တွင် 0.844 0 န်းကျင်တွင် 0.844 ကို 0.844 တွင်ရှိသည်။ GSM-8K Dataset တွင် BLELSEEK-R1 ၏ Develseek-R1 ၏ရေတံခွန်သည် O1 နှင့် O1-mini နှစ်ခုလုံးထက်သာလွန်မြင့်မြတ်သောစွမ်းဆောင်ရည်ကိုရရှိခဲ့သည်။

Livecodebench နှင့် codeforces များကဲ့သို့သော coding အလုပ်များတွင် DeepSeek-R1 ၏လည်ပင်းနှင့်ပတ်သက်သောမော်ဒယ်များသည် O1-mini နှင့် GPT-4o တို့နှင့်အလားတူပင်ဖျော်ဖြေတင်ဆက်ခဲ့သည်။ သို့သော်ပိုမိုကျယ်ပြန့်သောမော်ဒယ်များသည်ပိုမိုကျယ်ပြန့်သောဘာသာစကားများကိုပိုမိုကျယ်ပြန့်သောဘာသာစကားများကိုပိုမိုကျယ်ပြန့်သောဘာသာစကားများကိုနားလည်ရန်လိုအပ်သည့်အလုပ်များတွင်အားသာချက်များရှိသေးသည်။

သူတို့၏အားသာချက်များရှိသော်လည်းအသေးစားမော်ဒယ်များသည်ကျိုးကြောင်းဆင်ခြင်မှုကျိုးကြောင်းဆင်ခြင်မှုလုပ်ငန်းများကိုသို့မဟုတ်ဖြန့်ဖြူးသောအချက်အလက်များနှင့်ရင်ဆိုင်ရသောအခါရုန်းကန်နေရသည်။ ဥပမာအားဖြင့် LLM Chess Simulats တွင် DeepSeek-R1 သည်ပိုမိုကြီးမားသောမော်ဒယ်များထက်ပိုမိုကြီးမားသောမော်ဒယ်များထက်ပိုမိုကြီးမားသောအချိန်ကာလများကိုထိန်းသိမ်းထားနိုင်သည့်စွမ်းရည်နှင့်တိကျမှန်ကန်မှုကိုထိန်းသိမ်းရန်စွမ်းရည်ကိုဖော်ပြသည်။

အပေးအယူ - လက်တွေ့ကျသောသက်ရောက်မှုများ

SRMS ကို GPT-Level Lrms နှင့်နှိုင်းယှဉ်သောအခါ Model အရွယ်အစားနှင့်စွမ်းဆောင်ရည်အကြားကုန်သွယ်မှုသည်အရေးပါသည်။ သေးငယ်သည့်မော်ဒယ်များသည်မှတ်ဉာဏ်နှင့်ကွန်ပျူတာစွမ်းအင်နည်းပါးသည်။ ဤအကျိုးသက်ရောက်မှုသည် opsseek-R1 ကဲ့သို့သောမော်ဒယ်များနှင့်အတူ Models များကဲ့သို့ Models များထက် 96% စျေး 0 ယ်ခြင်းများနှင့်အတူ Models များထက်ပိုမိုစျေးသက်သာသည်။

သို့သော်ဤထိရောက်မှုသည်အချို့သည်အချို့သောအပေးအယူများနှင့်အတူလာသည်။ သေးငယ်သောမော်ဒယ်များကိုပုံမှန်အားဖြင့်သတ်သတ်မှတ်မှတ်အလုပ်များအတွက်ညှိနှိုင်းထားပြီး၎င်းသည်ပိုမိုကြီးမားသောမော်ဒယ်များနှင့်နှိုင်းယှဉ်လျှင်သူတို့၏ဘက်စုံကိုကန့်သတ်နိုင်သည်။ ဥပမာအားဖြင့်, သင်္ချာနှင့် coding တွင် Break-R1 ထူးကဲသည် Multseled နှင့် coding များ၌ MultoModal စွမ်းရည်များနည်းပါးသည်။

ဤအကန့်အသတ်ရှိသော်လည်း, ကျန်းမာရေးစောင့်ရှောက်မှုတွင်သူတို့သည်ပုံမှန်ဆေးရုံဆာဗာများနှင့်ပတ်သက်သည့်ဆေးဘက်ဆိုင်ရာအချက်အလက်များကိုဆန်းစစ်သောရောဂါရှာဖွေရေးကိရိယာများကိုပါ 0 င်နိုင်သည်။ ပညာရေးတွင်၎င်းတို့ကိုကျောင်းသားများအားပြန်လည်ပြင်ဆင်ခြင်းကိုထောက်ပံ့ပေးသည့်ကိုယ်ပိုင်ကျူရှင်စနစ်များကိုတည်ဆောက်ရန်အသုံးပြုနိုင်သည်။ သိပ္ပံနည်းကျသုတေသနတွင်အချက်အလက်ခွဲခြမ်းစိတ်ဖြာခြင်းနှင့်အတွေးအခေါ်များကိုသင်္ချာနှင့်ရူပဗေဒကဲ့သို့သောလယ်ကွင်းများတွင်စမ်းသပ်ခြင်းကိုအထောက်အကူပြုနိုင်သည်။ Open-roll-source roundels ၏ opensseek-r1 ကဲ့သို့သောမော်ဒယ်များသည်ပူးပေါင်းဆောင်ရွက်မှုကိုဖြည့်ဆည်းပေးနိုင်သည်။

အောက်ခြေလိုင်း

ဘာသာစကားမော်ဒယ်များကိုသေးငယ်သောကျိုးကြောင်းဆင်ခြင်မှုမော်ဒယ်များသို့ဆင့်ကဲပြောင်းလဲမှုသည် AI တွင်သိသာထင်ရှားသောတိုးတက်မှုများကိုကိုယ်စားပြုသည်။ ဤမော်ဒယ်များသည်ကြီးမားသောဘာသာစကားမော်ဒယ်များ၏ကျယ်ပြန့်သောစွမ်းရည်များကိုအပြည့်အဝမလိုက်သေးသော်လည်း၎င်းတို့သည်ထိရောက်မှု, ကုန်ကျစရိတ်နှင့်ထိရောက်မှုနှင့်လက်လှမ်းမီမှုတို့တွင်အဓိကအားသာချက်များကိုပေးသည်။ ကျိုးကြောင်းဆင်ခြင်မှုနှင့်အရင်းအမြစ်စွမ်းဆောင်ရည်အကြားမျှတမှုကိုသပိတ်မှောက်ခြင်းအားဖြင့်သေးငယ်သည့်မော်ဒယ်များသည် application အမျိုးမျိုးတွင်အရေးပါသောကဏ် role မှပါဝင်ရန်အဆင်သင့်ဖြစ်နေသည်။

-

1

Stardew Valley- ကျက်သရေရှိမှုနှင့် လက်နက်အတုပြုလုပ်ရန် လမ်းညွှန်ချက်အပြည့်အစုံ

Jan 07,2025

-

2

Roblox UGC ကန့်သတ်ကုဒ်များကို 2025 ခုနှစ် ဇန်နဝါရီလတွင် ထုတ်ဖော်ပြသခဲ့သည်။

Jan 06,2025

-

3

Pokémon TCG Pocket- ပြဿနာဖြေရှင်းခြင်း Error 102 ကို ဖြေရှင်းပြီးပါပြီ။

Jan 08,2025

-

4

Blue Archive Cyber New Year March Event ကို ထုတ်ဖော်ပြသသည်။

Dec 19,2024

-

5

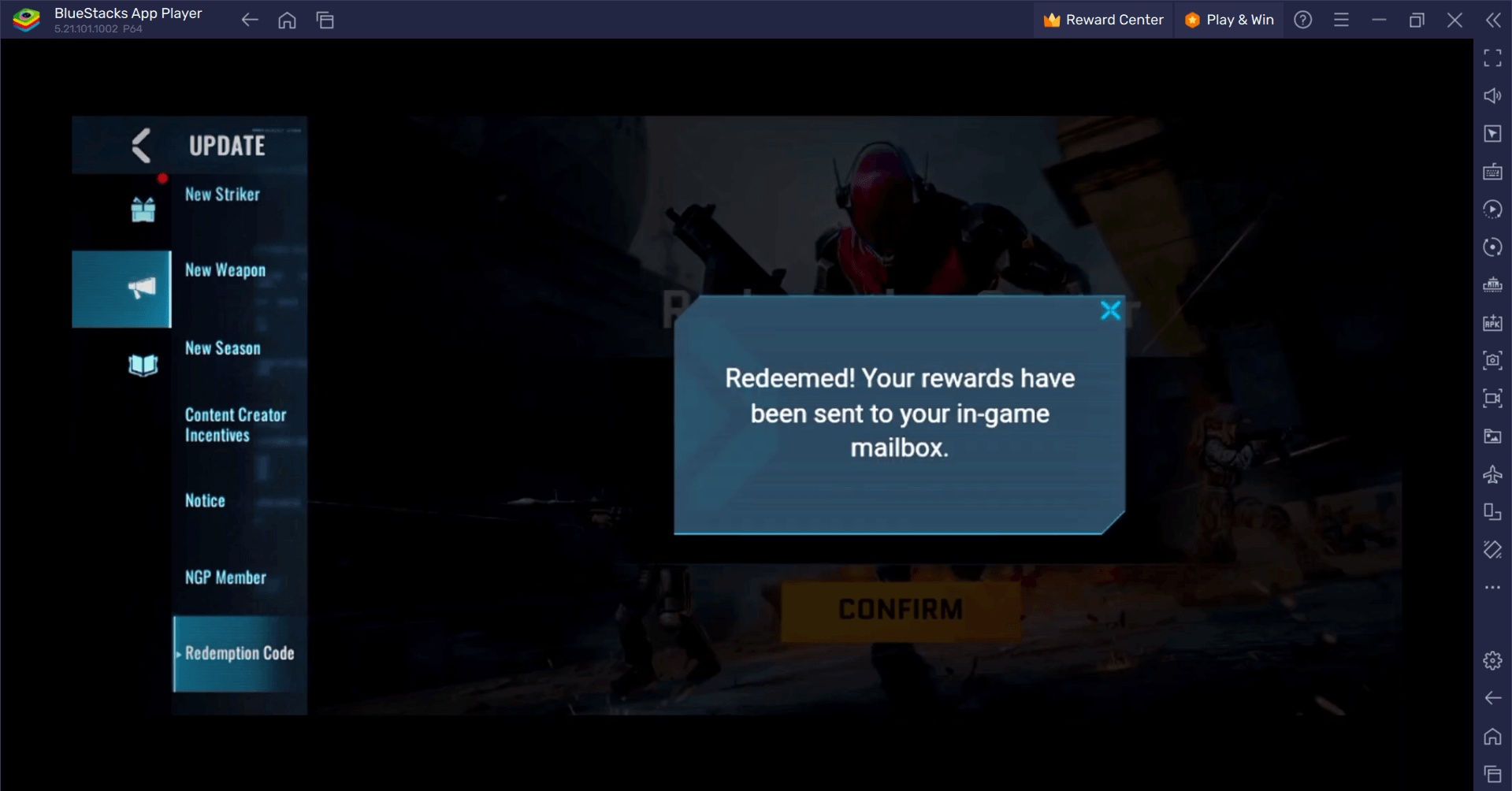

Blood Strike - 2025 ခုနှစ် ဇန်န၀ါရီလ 2025 တွင် အလုပ်လုပ်သော ရွေးနုတ်ကုဒ်များအားလုံး

Jan 08,2025

-

6

Cyber Quest- Android တွင်စွဲမက်ဖွယ်ကောင်းသော Card Battles တွင်ပါဝင်ပါ။

Dec 19,2024

-

7

![roblox forsaken ဇာတ်ကောင် Tier List [update] (2025)](https://imgs.ksjha.com/uploads/18/17380116246797f3e8a8a39.jpg)

roblox forsaken ဇာတ်ကောင် Tier List [update] (2025)

Mar 17,2025

-

8

Bart Bonte သည် ကြောင်တစ်ကောင်ကို 'For' ကိုရယူရန် သင်ကစားသည့်နေရာတွင် မစ်စတာအန်တိုနီယို ပဟေဋ္ဌိအသစ်တစ်ခုကို ချပေးခဲ့သည်။

Dec 18,2024

-

9

Sony အသစ်ထွက်ရှိ Midnight အနက်ရောင် PS5 ဆက်စပ်ပစ္စည်းများ

Jan 08,2025

-

10

Roblox- RIVALS ကုဒ်များ (ဇန်နဝါရီ 2025)

Jan 07,2025

-

ဒေါင်းလုဒ်လုပ်ပါ။

Random fap scene

ပေါ့ပေါ့ပါးပါး / 20.10M

အပ်ဒိတ်: Dec 26,2024

-

ဒေါင်းလုဒ်လုပ်ပါ။

![Corrupting the Universe [v3.0]](https://imgs.ksjha.com/uploads/66/1719514653667db61d741e9.jpg)

Corrupting the Universe [v3.0]

ပေါ့ပေါ့ပါးပါး / 486.00M

အပ်ဒိတ်: Dec 17,2024

-

ဒေါင်းလုဒ်လုပ်ပါ။

Arceus X script

စိတ်ကြိုက်လုပ်ပါ။ / 127.00M

အပ်ဒိတ်: Oct 21,2021

-

4

A Simple Life with My Unobtrusive Sister

-

5

Ben 10 A day with Gwen

-

6

A Wife And Mother

-

7

Permit Deny

-

8

Oniga Town of the Dead

-

9

Cute Reapers in my Room Android

-

10

Piano White Go! - Piano Games Tiles